У Китаї штучному інтелекту дозволили самостійно звинувачувати людей у деяких злочинах

У Китаї розробили програму, яка за допомогою штучного інтелекту може замість прокурора вивчати кримінальну справу та ухвалювати рішення про висунення звинувачення.

Про це повідомляє South China Morning Post.

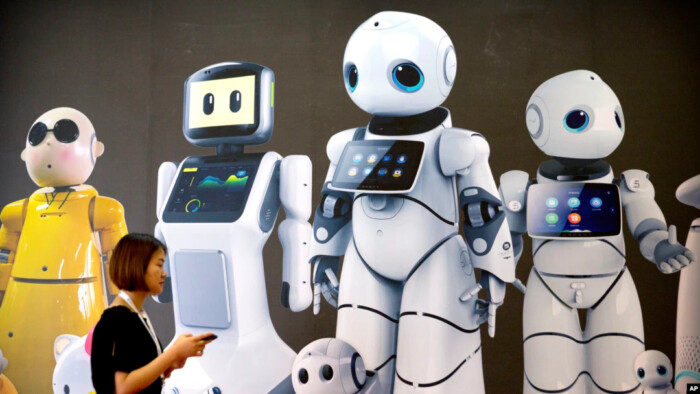

Фото: VCG

Фото: VCGРозроблення на замовлення прокуратури Шанхая створили вчені Китайської академії наук. Вони на 17 тисячах справ, які розглядали з 2015 до 2020 року, навчили штучний інтелект ухвалювати правильне рішення про висунення звинувачення у 97% випадків.

Програмі нині дозволили працювати з вісьмома найпоширенішими типами злочинів у Шанхаї, а саме крадіжками коштів з банківських карток, незаконними азартними іграми, небезпечним водінням, навмисним заподіянням травм, крадіжками, шахрайством, перешкоджанням виконанню службових обов’язків та провокуванням неприємностей. Останнє звинувачення китайська влада часто використовує для переслідування дисидентів.

Надалі штучному інтелекту планують дозволити працювати й з іншими злочинами.

Критики програми вважають, що ймовірність помилки під час висунення звинувачення занадто висока, а сам алгоритм роботи на підставі судових прецедентів не дозволяє підлаштуватися під наявні соціальні умови. Також вони наголошують, що в разі помилки не зрозуміло, хто саме має відповідати: прокурор чи розробник алгоритму.

Із 2016 року в Китаї працює так звана “Система 206” – програма зі штучним інтелектом для кримінальних справ, що оцінює переконливість доказів провини та ступінь небезпеки ймовірного злочинця для суспільств. Її використовують прокурори, яким алгоритм надає лише рекомендації щодо запобіжного заходу. Розроблена Китайською академією наук нова програма взагалі не потребує участі людей.

Китайська влада активно впроваджує алгоритми зі штучним інтелектом для регулювання різних сфер життя, зокрема й для стеження за громадянами. Декілька років тому в країні камера розпізнала обличчя підозрюваного в злочині серед 60-тисячного натовпу.

Правозахисники останнім часом більше говорять про те, що без належного врегулювання нові технології можуть становити ризики для права людей на приватність, вираження поглядів, свободу релігії, а також мирні зібрання у всьому світі. Декілька років тому в ЄС розробили етичні рекомендації для створення систем штучного інтелекту.

Нагадаємо, що наприкінці минулого року український уряд затвердив концепцію розвитку ШІ.