Твіттер заплатить українському програмісту 3,5 тисячі доларів за доведену упередженість у алгоритмі соцмережі

Американська компанія “Twitter” заплатила 3,5 тисячі доларів українському програмісту Богдану Кулінічу, який довів, що алгоритм соцмережі упереджений по відношенню до людей з темним кольором шкіри на фотографіях.

Про це повідомляє The Guardian.

Фото: github.com

Фото: github.comБогдан Кулініч – аспірант Федеральної політехнічної школи Лозанни. Дослідити алгоритм соцмережі він вирішив після заяв аспіранта Коліна Медленда із Канади, який минулого року першим повідомив про упередженість механізму. Заяви канадця спричинили тоді хвилю обурення, а адміністрація компанії вибачилась і пообіцяла виплатити винагороду тим, хто доведе факт існування проблеми на більшій кількості прикладів.

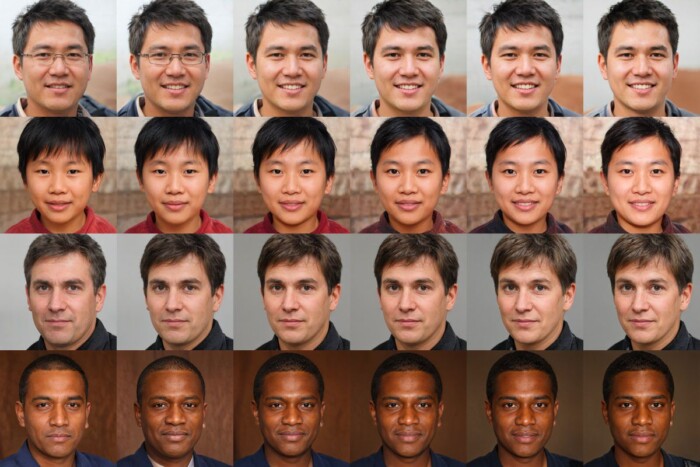

За допомогою штучного інтелекту Кулініч згенерував знімки з майже ідентичними обличчями, які відрізнялися лише тоном шкіри, статтю, віком і комплекцією. Програміст також виявив, що алгоритм твіттера краще фокусується на більш молодих, струнких і світлошкірих людях.

“Алгоритмічна шкода – не просто помилка. Вкрай важливо, що багато шкідливих технологій є такими не через випадковості чи ненавмисні помилки, а радше за замовчуванням. Це робиться від бажання максимізувати залученість і прибуток”, – припускав він у своєму мікроблозі.

Фото: github.com

Фото: github.comОкрім Кулініча твіттер виплатить гроші також іншим дослідникам, які довели, що алгоритм обрізання зображень сильніше маргіналізує літніх і людей з інвалідністю, а також, що він з більшою ймовірністю обрізав на мемах арабський текст, аніж англійський. Компанія вже пообіцяла виправити помилки.

Штучний інтелект сьогодні широко застосовують у світі у різних сферах, зокрема в правоохоронній, судовій та навіть для запобігання харасменту. Проте правозахисники частіше кажуть про те, що без належного врегулювання нові технології можуть становити ризики для права людей на приватність, вираження поглядів, свободу релігії, а також мирні зібрання.

Наразі вже відомо декілька випадків, коли використання штучного інтелекту, наприклад, під час добору кандидатів на роботу, негативно впливало на гендерну рівність. Так, три роки тому компанія Amazon відмовилася від використання ШІ для оцінювання резюме, оскільки високі бали отримували переважно здобувачі-чоловіки.