Провідні розробники штучного інтелекту посилюватимуть заходи проти сексуального насильства над дітьми в інтернеті

Технологічні корпорації світового рівня, зокрема OpenAI, Microsoft, Google, Meta та інші, зобов’язалися запобігати використанню їхніх інструментів штучного інтелекту для експлуатації дітей і створення матеріалів про сексуальне насильство над ними. Ініціативу очолили правозахисна група Thorn та громадська організація All Tech Is Human, зосереджена на відстоюванні відповідального впровадження технологій.

Про це пише видання Engadget.

Фото: Getty Images

Фото: Getty ImagesЦе зобовʼязання, як зазначає Thorn, створює новаторський прецедент для галузі та є значним стрибком у зусиллях із захисту дітей від сексуального насильства як функції з розгортанням генеративного штучного інтелекту. Мета ініціативи – запобігти створенню матеріалів відвертого сексуального характеру за участю дітей і видалити їх із соціальних мереж і пошукових систем.

За даними організації, тільки 2023 року в США зареєстрували понад 104 мільйони файлів з матеріалами, які мають ознаки сексуального насильства над дітьми. За відсутності колективних дій генеративний штучний інтелект може погіршити цю проблему та перевантажити правоохоронні органи, які вже намагаються ідентифікувати потерпілих.

Thorn і All Tech Is Human опублікували статтю, у якій містяться стратегії та рекомендації для компаній, які створюють інструменти штучного інтелекту, є власниками пошукових систем, хостингових платформ чи соціальних мереж, щодо заходів, яких слід вжити, щоб запобігти використанню генеративного ШІ для шкоди дітям.

Зокрема, розробників штучного інтелекту просять уникати для його навчання наборів даних, які містять лише випадки сексуального насильства, або контенту сексуального характеру для дорослих через схильність генеративного штучного інтелекту поєднувати ці дві концепції.

Компанії, які представляють платформи соціальних медіа та пошукові системи, просять видалити посилання на сайти та програми, що дозволяють людям генерувати зображення оголених дітей.

“Генеративний штучний інтелект робить створення більших обсягів контенту простішим, ніж будь-коли раніше. Ця технологія відкриває можливість “хижакам за дітьми” швидко створювати матеріали про сексуальне насильство над ними у великих масштабах.

Ці зловмисники можуть адаптувати оригінальні зображення та відео в нові матеріали про насильство, повторно віктимізуючи дитину в цьому контенті, або маніпулювати нешкідливими матеріалами дітей у сексуальному контенті, або створювати сексуалізовані зображення дітей, повністю згенеровані штучним інтелектом”, – пояснюють у матеріалі.

За інформацією віцепрезидентки Thorn із науки про дані Ребеки Портнофф, окремі компанії вже погодилися відокремити зображення, відео та аудіо, які стосуються дітей, від наборів даних, що мають вміст для дорослих, щоб запобігти їхньому поєднанню під час навчання моделей ШІ. Інші – додають водяні знаки для ідентифікації створеного штучним інтелектом контенту, однак цей метод не є досить надійним, адже водяні знаки та метадані можна видалити.

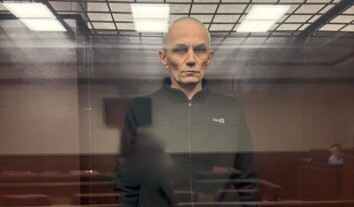

Нагадаємо, що у Великій Британії чоловіку, засудженому за створення більш ніж тисячі непристойних зображень дітей, заборонили користуватись інструментами штучного інтелекту протягом наступних пʼяти років. Цей випадок може створити прецедент для майбутнього моніторингу людей, засуджених за генерування непристойних зображень.